Sur un catalogue PrestaShop de plusieurs milliers de références, une part massive de vos fiches produits peut rester invisible pour Google. Des pages fantômes, jamais crawlées, jamais indexées. Résultat : du chiffre d’affaires qui s’évapore silencieusement.

Les catalogues volumineux concentrent des défis techniques bien spécifiques. Budget crawl limité, URLs dynamiques multipliées par les filtres, contenu dupliqué entre variantes… Chaque problème amplifie le suivant. Google finit par ignorer vos pages les plus rentables au profit de pages sans aucune valeur commerciale.

Cet article détaille les causes principales des problèmes d’indexation sur PrestaShop en 2026, puis livre des solutions techniques concrètes pour reprendre le contrôle de votre visibilité organique.

Pourquoi un gros site PrestaShop rencontre-t-il des problèmes d’indexation ?

Le budget crawl représente le nombre de pages que Googlebot accepte d’explorer sur votre site à chaque passage. Avant d’engager toute correction, faire auditer le SEO de son site par un professionnel permet de mesurer l’ampleur exacte du gaspillage. Sur un gros PrestaShop, ce budget fond comme neige au soleil quand des milliers de pages parasites captent l’attention du robot.

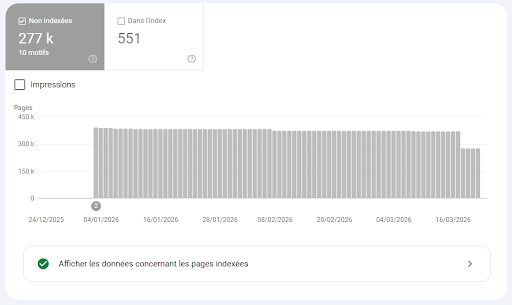

Dans la Google Search Console, le statut “Page explorée, actuellement non indexée” revient souvent. Google a visité la page, l’a jugée sans intérêt, puis l’a écartée. Ce verdict touche fréquemment les URLs de filtres, les pages de pagination profonde et les doublons de fiches produits.

PrestaShop génère aussi des pages techniques indexables par défaut : panier, login, tunnel de commande. Ces pages diluent votre crawl sans apporter le moindre trafic qualifié. Le bug historique de vidage de l’index de recherche interne (présent depuis la version 1.7.4.x) aggrave encore la situation sur les installations non mises à jour.

Explosion des URLs liée aux filtres et combinaisons de paramètres

Le module ps_facetedsearch crée une URL unique pour chaque combinaison de filtres. Couleur bleue + taille M + prix 20-50€ + marque X ? Voilà une page distincte que Google peut tenter de crawler.

Sur un catalogue de 10 000 produits, les facettes génèrent facilement plusieurs centaines de milliers d’URLs. Googlebot épuise son budget sur ces pages à faible valeur et ne parvient jamais jusqu’à vos fiches produits stratégiques. Vos meilleures catégories restent dans l’ombre.

Contenu dupliqué et cannibalisation entre pages

Les produits déclinés en variantes (coloris, tailles) créent du duplicate content massif quand chaque déclinaison possède sa propre URL avec un contenu quasi identique. PrestaShop ne configure pas toujours correctement les URLs canoniques par défaut.

La pagination pose un problème similaire. Chaque page de catégorie (page 2, page 3, page 47…) partage le même title, la même meta description. Google perçoit ces pages comme des doublons sans valeur ajoutée et hésite sur laquelle indexer.

Comment diagnostiquer précisément les problèmes d’indexation de votre boutique PrestaShop ?

Le rapport de couverture d’indexation dans Google Search Console constitue votre point de départ. Filtrez par statut “Exclues” pour identifier exactement pourquoi Google rejette vos pages : contenu dupliqué, noindex détecté, erreur de crawl ou page explorée non indexée.

Comparez ensuite le nombre de pages soumises via votre sitemap XML au nombre réellement indexées. Un écart supérieur à 30% signale un problème structurel sérieux. L’analyse des logs serveur révèle le comportement réel de Googlebot : quelles URLs il visite en priorité, combien de fois par semaine, et celles qu’il ignore totalement.

Des outils comme Screaming Frog ou Sitebulb complètent ce diagnostic en cartographiant la structure technique complète de votre boutique.

Quelles solutions techniques pour corriger l’indexation d’un site PrestaShop en 2026 ?

Désindexer les pages inutiles avec les balises noindex et le robots.txt

La priorité absolue : empêcher Google de gaspiller son budget sur des pages sans potentiel commercial.

- Ajouter une balise meta noindex sur les pages panier, login, tunnel de commande et résultats de recherche interne

- Bloquer les URLs à paramètres de filtres via une directive noindex (plus fiable que le robots.txt seul pour ce cas)

- Installer un module PrestaShop dédié (type “Noindex Manager”) pour gérer ces règles directement depuis le back-office

Cette seule action libère une part considérable du budget crawl pour vos pages rentables.

Mettre en place des URLs canoniques et optimiser le sitemap XML

Les canonical tags indiquent à Google quelle version d’une page fait référence. Configurez-les systématiquement sur chaque fiche produit et chaque page catégorie pour éliminer le duplicate content.

Votre sitemap XML mérite un nettoyage radical. Conservez uniquement :

- Les fiches produits actifs et en stock

- Les catégories principales

- Les pages CMS stratégiques (guides d’achat, pages de marque)

Excluez toutes les URLs de filtres, la pagination profonde et les pages techniques sans valeur SEO. Soumettez ce sitemap propre dans la Search Console immédiatement après modification.

Mettre à jour PrestaShop et corriger les bugs d’indexation interne

Passer à une version récente de PrestaShop corrige les bugs connus de vidage d’index de recherche. Cette mise à jour reste capitale pour les boutiques encore en 1.7.x.

Vérifiez que vos tâches CRON de réindexation s’exécutent correctement et à la bonne fréquence. Un CRON silencieusement en échec depuis des mois, ça arrive plus souvent qu’on le croit. Inspectez aussi les tables de base de données liées à l’indexation (ps_search_index, ps_search_word) : des tables corrompues bloquent toute la chaîne.

Bonnes pratiques pour maintenir une indexation saine sur un gros catalogue PrestaShop

Surveiller la Search Console chaque semaine permet de détecter une régression d’indexation avant qu’elle n’impacte le trafic. Mettez en place des alertes automatisées qui se déclenchent si le nombre de pages indexées chute de plus de 10% en quelques jours.

La vitesse du serveur influence directement le volume de pages crawlées par session Googlebot. Un temps de réponse serveur inférieur à 200 ms maximise ce volume. Adoptez une architecture de site plate où chaque produit reste accessible en trois clics maximum depuis la page d’accueil.

Le maillage interne oriente le crawl vers vos pages à fort potentiel commercial. Reliez vos catégories phares entre elles, insérez des liens contextuels dans vos descriptions produits, et créez des pages piliers qui centralisent l’autorité vers vos segments les plus rentables.

FAQ

Combien de temps faut-il pour que Google réindexe un site PrestaShop après correction ?

Comptez généralement entre 2 et 6 semaines selon la taille de votre catalogue et la gravité des problèmes corrigés. Les petits sites constatent des améliorations plus rapidement que les catalogues de dizaines de milliers de références.

Pour accélérer le processus, soumettez votre sitemap mis à jour dans la Search Console et utilisez l’outil d’inspection d’URL sur vos pages stratégiques prioritaires. Google traite ces demandes manuelles plus vite que le crawl naturel.